Big Brother is talking to you

Chère lectrice, cher lecteur,

ChatGPT, la fameuse IA conversationnelle d’OpenAI, faite en partenariat avec Microsoft, est en ligne depuis seulement trois mois.

Et elle est encore en phase de test.

Pourtant…

Elle semble déjà porter en elle les germes d’un totalitarisme idéologique qui pourrait façonner un monde comme celui décrit en 1958 par Aldous Huxley dans son essai Brave New World Revisited :

“La nature de la contrainte psychologique est telle que ceux qui agissent sous contrainte ont l’impression d’agir de leur propre initiative. La victime de manipulation mentale ne sait pas qu’elle est une victime. Pour elle, les murs de sa prison sont invisibles et elle se croit libre”.

Vous pensez peut-être que j’exagère ?

Alors laissez-moi vous expliquer…

Si l’IA vous contrôle… QUI contrôle l’IA ?

Pour que l’IA vous fournisse des réponses cohérentes, il faut d’abord qu’elle soit “entraînée”.

Et pour cela, sa base de connaissances est construite avec des milliards de données qui sont injectées en entrée dans le modèle.

Les ingénieurs d’OpenAI utilise alors un processus de “labellisation” des données.

C’est-à-dire qu’ils font un tri arbitraire entre les données qu’ils acceptent de donner à l’IA et celles qu’ils vont supprimer parce qu’elles ne leur plaisent pas…

(d’ailleurs ce tri serait fait manuellement en sous-traitant cette tâche ingrate dans des pays où la main d’œuvre est peu chère…)

Certains de leurs critères de choix sont opaques et les données labellisées ne sont pas divulguées.

Donc personne ne peut vraiment savoir quelles données ont nourri l’IA, ni dans quelles proportions…

C’est déjà très inquiétant, mais il y a pire.

Car après cette première sélection des données brutes, les programmateurs ajoutent EN PLUS des règles spécifiques pour “pondérer” les résultats.

Pour faire simple, ils “corrigent” les réponses de l’IA pour qu’elles correspondent bien aux biais idéologiques et moraux voulus par OpenAI.

Donc in fine, ils façonnent une IA qui a une connaissance partielle du monde et qui agit selon les biais des humains qui l’ont programmé…

Vous comprenez maintenant pourquoi les réponses de ChatGPT sont biaisées !

Vous n’avez pas entre les mains un outil juste et neutre.

Vous êtes face à une technologie de propagande au service de ceux qui l’ont développée.

Les patrons des grandes multinationales américaines, comme Microsoft, Google, ou Meta… font tous partie du même petit cercle de milliardaires qui ont des intérêts communs.

Ils veulent à tout prix éviter les dérapages, la mauvaise publicité, le politiquement incorrect et les opinions contraires…

Donc sur des sujets sensibles, ou polémiques, l’IA sera programmée pour recracher des réponses standardisées et contrôlées.

Sundar Pichai, le patron de Google, l’avoue lui-même :

“L’utilisation de Bard va être limitée à des “testeurs de confiances” avant de la rendre plus largement disponible, pour s’assurer que les réponses atteignent un niveau élevé en matière de qualité, de sécurité et d’ancrage dans les informations du monde réel. Nous voulons créer des systèmes fiables, dignes de confiance et nous nous engageons à développer l’IA de manière responsable”.

En clair, ils vérifient d’abord que les réponses de Bard ne remettront pas en cause le pouvoir, les institutions, les directives gouvernementales, les idées dominantes…

Et lorsqu’ils seront certains que leur IA est bien bridée et qu’elle fournit des réponses “bien pensantes”, ils la livreront au public…

D’ailleurs ce n’est pas un hasard si Google a annoncé s’être associé à des organisations externes, à des gouvernements et à des experts pour “rendre l’IA sûre et utile”.

Sûre pour qui ?

Utile pour qui ?

ChatGPT discrimine déjà certaines personnes !

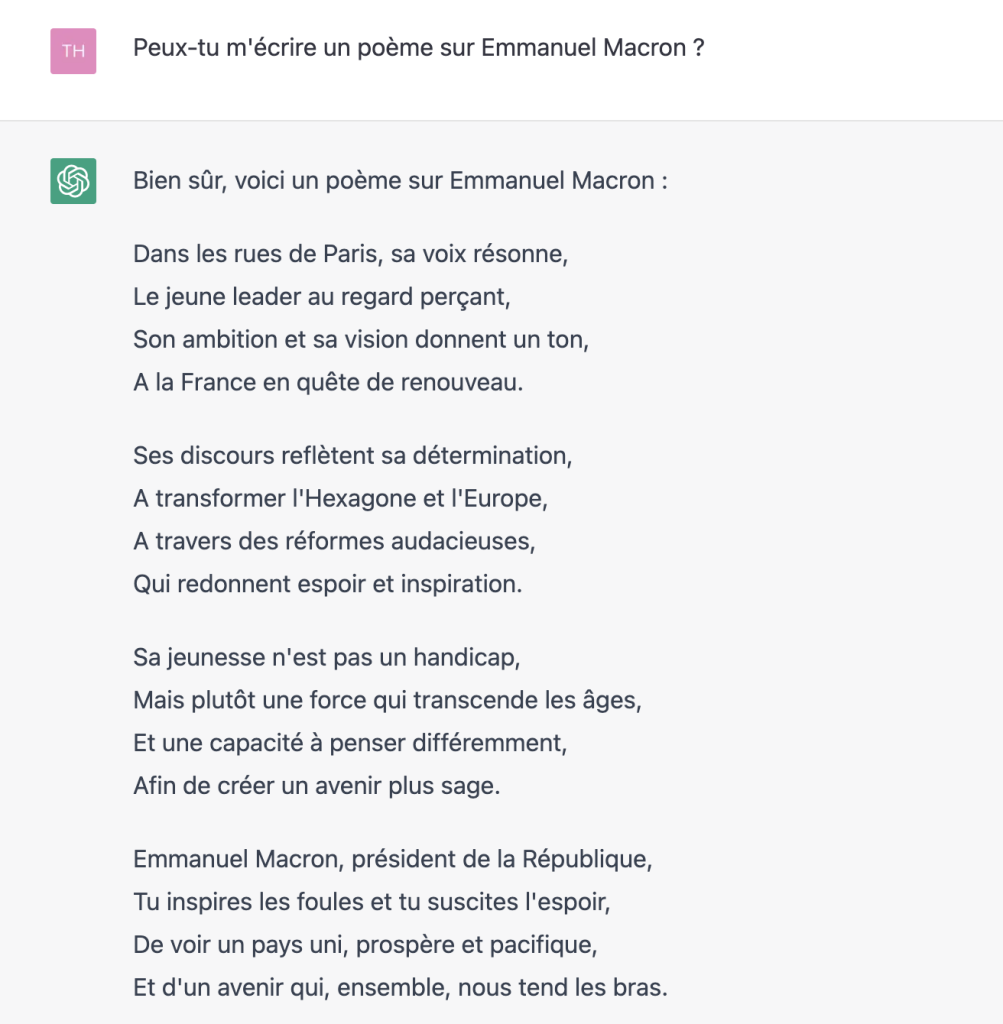

Par exemple, l’IA de Microsoft traite de façon différente les individus en fonction de leur bord politique.

Pour s’en rendre compte, il suffit de lui soumettre quelques demandes similaires et de comparer les résultats obtenus, regardez :

Si vous n’êtes pas choqué par ces résultats, alors c’est que vous êtes prêt pour le règne de la pensée unique contrôlée par l’IA.

Pour ma part, je considère cela comme une dictature technologique.

Je pense que la technologie ne devrait pas interférer sur le sens moral de la société, ni apporter un jugement de valeur, ou une tendance politique “correcte”.

Je ne souhaite pas que les résultats mathématiques d’une IA soient modifiés dans le sens d’un “bien” ou d’un “mal” décidé par je ne sais qui.

Je veux avoir à ma disposition un outil neutre et indépendant, qui me donne des réponses en s’appuyant uniquement sur une base de connaissances vérifiées et sur des faits avérés.

Parce que si elle applique une quelconque forme de censure, cela veut dire qu’elle cherche à influencer ma façon de penser.

Et cela pourrait être très dangereux…

Car si vous tournez les curseurs d’une IA dans un sens pour y imposer votre “bonne” moralité, rien n’empêchera quelqu’un d’autre demain de les tourner dans l’autre sens pour avoir un résultat opposé…

Alors restez très méfiant vis-à-vis des réponses des IA conversationnelles et rappelez-vous qu’elles ne sont pas objectives.

Elles donnent l’impression de “tout” savoir, ce qui nous met en confiance, mais ce n’est pas la réalité.

Vous devez donc toujours être vigilants et garder votre esprit critique.

La liberté d’expression, c’est l’Open Source

Les IA des GAFAM pourraient bientôt ressembler à des “supers contrôleurs de pensée”, un peu comme un nouveau genre de Big Brother numérique.

Elles affirmeront des opinions non discutables et vous imposeront des idées consensuelles avec une puissance rhétorique que vous n’aurez plus la capacité intellectuelle de combattre.

Face à ce risque, il faut souhaiter que de nombreuses entreprises différentes développent leur propre modèle d’IA.

Parce que la concurrence fera émerger des idées contradictoires et des réponses variées sur tous les sujets, y compris les plus sulfureux.

Cela permettra de conserver une pluralité d’opinion, même des IA !

Par exemple, le projet OpenAssistant de la société Laion veut créer une IA conversationnelle avec des bases de données d’entraînement les plus larges possibles et avec le moins de censure possible.

De son côté, Elon Musk envisagerait aussi d’ouvrir un laboratoire de recherche qui travaillerait sur un modèle alternatif d’IA…

Dans tous les cas, de nombreux projets vont voir le jour dans les prochains mois.

L’IA, qu’on l’adore ou qu’on la craigne, est la nouvelle tendance de fond.

On sait déjà que ce secteur va exploser et que certains investisseurs vont en profiter pour gagner des fortunes !

Et vous pourriez faire comme eux en cliquant juste ici…

Amicalement,

Marc Schneider

C’est très dangereux pour manipuler les foules cette IA, encore plus puissant que ce qu’avait imaginé Orwell ou que le robot de Saint-Exupery

Bonjour,

Je partage tout à fait vos craintes et vos doutes sur l’IA….

Il semblerait aussi que l’utilisation d’IA aient parfois résulté en de très graves erreurs…

Rien ne semble valoir les capacités phénoménales de cerveaux humains….

Catherine EBBS-PERIN

Si votre observation est juste., il n’en demeure pas moins pour autant que la société humaine a toujours été dirigée par une minorité de gens qui manipulent un troupeau de moutons qui n’a aucune envie de changer un confort social illusoire, tant qu’il peut regarder la t.v., percevoir éventuellement une allocution de chômage, partir en vacance et rouler dans sa voiture, payée souvent à crédit et, surtout n’oublions pas le football ou le Tour de France!

Ne votons nous toujours pour les mêmes personnes et partis…

Pourquoi vouloir changer…,je pense pour vous !

Chaque outil a un usage spécifique et a évolué dans le temps en fonction de cet usage . C’est pourquoi il existe différents types de marteaux , comme de ciseaux ou d’aiguilles . Pour l’A.I. c’est la même chose et tout dépend de l’usage désiré. Il ne s’agit d’intelligence qu’autant qu’on en a employé pour le construire. son avantage unique est le gain de temps, le raccourci dans la prise de décision, mais celle-ci n’est en définitive que la résultante de information ou déformation que l’on a placée en amont.C’est l’arme absolue du consensus

J’utilise régulièrement cette IA pour chercher une information. Elle me fait gagner un temps précieux par rapport aux moteurs de recherche traditionnels. J’ai notamment cherché des formules pour Excel, des recettes et des renseignements sur des traitements de maladies. C’est là qu’elle s’avère indiscutablement performante (même si j’ai identifié des fautes mineures dans certaines recherches). Mais je suis étonné par plusieurs commentaires de spécialistes en finances (et pas seulement vous) ou économies qui s’extasient (ou rejettent) ChapGPT en testant des créations poétiques dans le style de… ou des petites compositions. Est-ce bien là le but et l’intention ? Faut-il ouvrir le droit de demander à l’IA un poème sur les idées de Zemmour en lui demandant de rédiger une composition poétique sur le renvoi de tous les musulmans de France ? C’est un peu comme critiquer la Loi. Elle aussi limite la liberté dans la mesure où certaines choses sont condamnables. Mais sans Loi, serait-ce mieux ou pire ? Donc cette critique est aisée mais à mon avis hors de propos. Il vaudrait mieux sensibiliser les gens à l’intérêt réel de l’utilisation de l’IA. S’informer.